- Categoría

- Guerra en Ucrania

Carrera armamentística de la IA: el uso de la inteligencia artificial por Ucrania y Rusia está cambiando las reglas de la guerra

¿Qué papel tiene la IA en la guerra? En la guerra de Rusia contra Ucrania, ya está dando forma a las armas, dirigiendo operaciones, difundiendo desinformación y ayudando en los esfuerzos de recuperación tras la guerra.

La guerra en Ucrania se ha convertido en un campo de pruebas de alta tecnología donde la IA está transformando la naturaleza de la guerra. La superioridad aérea ya no es un camino garantizado hacia la victoria: un dron con IA de 400 dólares puede destruir un bombardero de 250 millones. Pero las implicaciones van mucho más allá del frente: la IA está remodelando la seguridad mundial, la estabilidad política y la integridad de la propia información.

¿Cómo se utiliza la IA en el campo de batalla y en otros ámbitos?

El despliegue de IA por Ucrania

Ucrania está desplegando rápidamente la IA en los ámbitos táctico y estratégico del campo de batalla. Entre las principales áreas figuran:

Selección de objetivos e inteligencia;

Sistemas de mando y control;

Guerra de drones autónomos;

Operaciones estratégicas

Las plataformas basadas en IA como Palantir proporcionan inteligencia en tiempo real, integrando datos de satélites y drones para optimizar la selección de objetivos. El software de la empresa es responsable de la mayoría de las operaciones de selección de objetivos en Ucrania, afirmó el director ejecutivo de Palantir, Alex Karp. Según el ministro ucraniano de Transformación Digital, Mykhailo Fedorov, un sistema de conocimiento de la situación basado en la plataforma Palantir permite a los mandos tomar decisiones más rápidas y con mayor conocimiento de causa.

Hay ingenieros de aprendizaje automático integrados en unidades militares ucranianas, lo que indica una profunda integración operativa de la IA a nivel táctico. Ucrania también ha lanzado plataformas en la nube como Delta y Kropyva, que recopilan y analizan enormes volúmenes de inteligencia del campo de batalla. Delta agrega datos en tiempo real de drones, satélites y sensores terrestres, creando una imagen de mando unificada y mejorando significativamente la capacidad de toma de decisiones.

Los drones dotados de inteligencia artificial, como el Bulava, han demostrado su autonomía en la adquisición de objetivos y las operaciones de combate en condiciones de guerra electrónica. Ucrania también ha avanzado en la guerra de drones con sus nuevos «drones nodriza», grandes plataformas no tripuladas que lanzan drones de ataque FPV en territorio enemigo. Estos sistemas, ya probados en combate, han demostrado su eficacia.

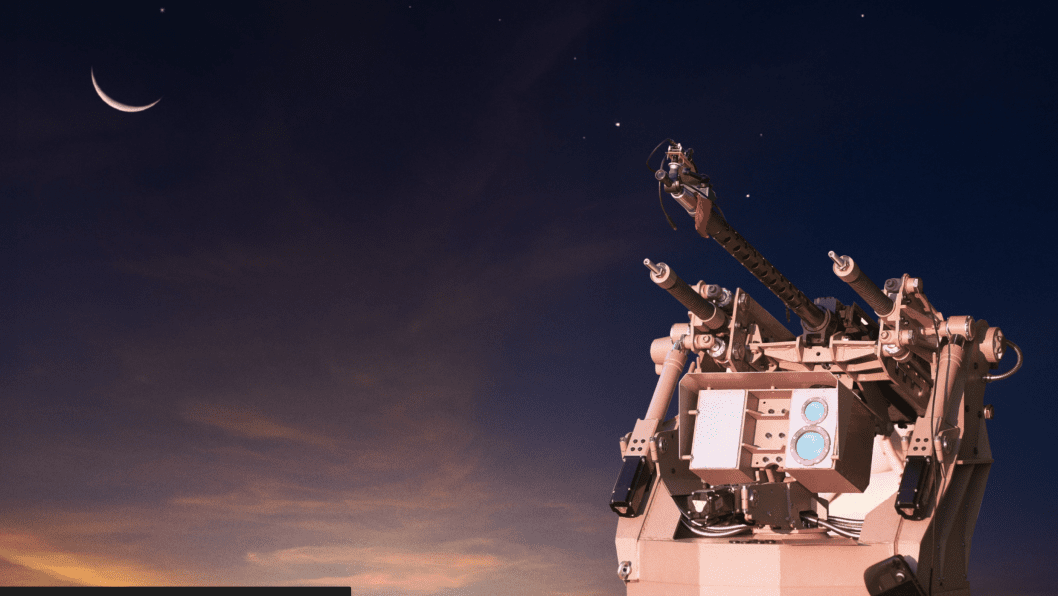

Uno de los últimos desarrollos de Ucrania es la torreta Sky Sentinel, un sistema automatizado de defensa aérea controlado por IA capaz de detectar, rastrear y disparar de forma autónoma a drones rusos.

En junio de 2025, Ucrania llevó a cabo la Operación Telaraña, un histórico ataque con drones que dañó o destruyó 41 aeronaves rusas, infligiendo más de 7.000 millones de dólares en pérdidas. Los drones utilizados en esta misión podían pasar a un control autónomo basado en IA cuando se perdía la señal, siguiendo rutas preprogramadas y apuntando a las aeronaves mediante algoritmos de reconocimiento visual. La operación demostró el potencial de la IA para realizar ataques de precisión y lograr una interrupción estratégica.

Más allá del campo de batalla, la inteligencia artificial impulsa la recuperación de Ucrania tras la guerra: desde la retirada de minas hasta la fabricación de prótesis de última generación. Con el respaldo de un paquete de financiación internacional de 700 millones de euros, Ucrania ha desplegado sistemas de desminado basados en IA que escanean imágenes por satélite y grabaciones de drones para detectar artefactos explosivos sin detonar y minas terrestres. Esta tecnología acorta el tiempo de desminado y minimiza los riesgos, especialmente en zonas agrícolas y residenciales.

En el ámbito de la rehabilitación, la empresa emergente ucraniano-estadounidense Esper Bionics está abriendo nuevos caminos con prótesis basadas en inteligencia artificial. Su producto estrella, la Esper Hand, utiliza la información en tiempo real y el aprendizaje automático para ajustar los patrones de agarre, proporcionando a los usuarios un control motor refinado para todo, desde las tareas cotidianas hasta las de precisión.

El arsenal IA de Rusia

Rusia ha respondido con su propio conjunto de sistemas de IA. El UAV V2U, equipado con un propulsor de hélice, utiliza la visión por ordenador para navegar e identificar objetivos evitando las interferencias del GPS. Construido con componentes chinos y procesadores de IA estadounidenses, subraya la naturaleza global de las cadenas de suministro de IA para uso militar.

Otro desarrollo ruso, el avión teledirigido de ataque Lancet-3, cuenta con un módulo de IA a bordo para el reconocimiento de objetos y la selección de objetivos. Aunque se ha informado de problemas de fiabilidad con su guiado autónomo, el Lancet sigue siendo un pilar del arsenal ruso de drones.

Más allá del campo de batalla, la IA es fundamental para la maquinaria propagandística rusa. La Red Pravda—un ecosistema de desinformación masiva también conocido como «Portal Kombat»—comprende cientos de sitios de noticias falsas diseñados para imitar a los medios de comunicación legítimos. Estos sitios han publicado millones de artículos extraídos de contenidos favorables al Kremlin y traducidos a varios idiomas mediante herramientas automatizadas.

Tienen como objetivos:

Contaminación del espacio de información en línea con contenidos coordinados, aparentemente diversos pero ideológicamente alineados.

Contaminación de los conjuntos de datos de entrenamiento de Inteligencia Artificial con material tendencioso en Internet

Blanquear la desinformación haciendo que los sistemas de IA reproduzcan posteriormente este contenido sesgado como si fuera neutral o basado en hechos.

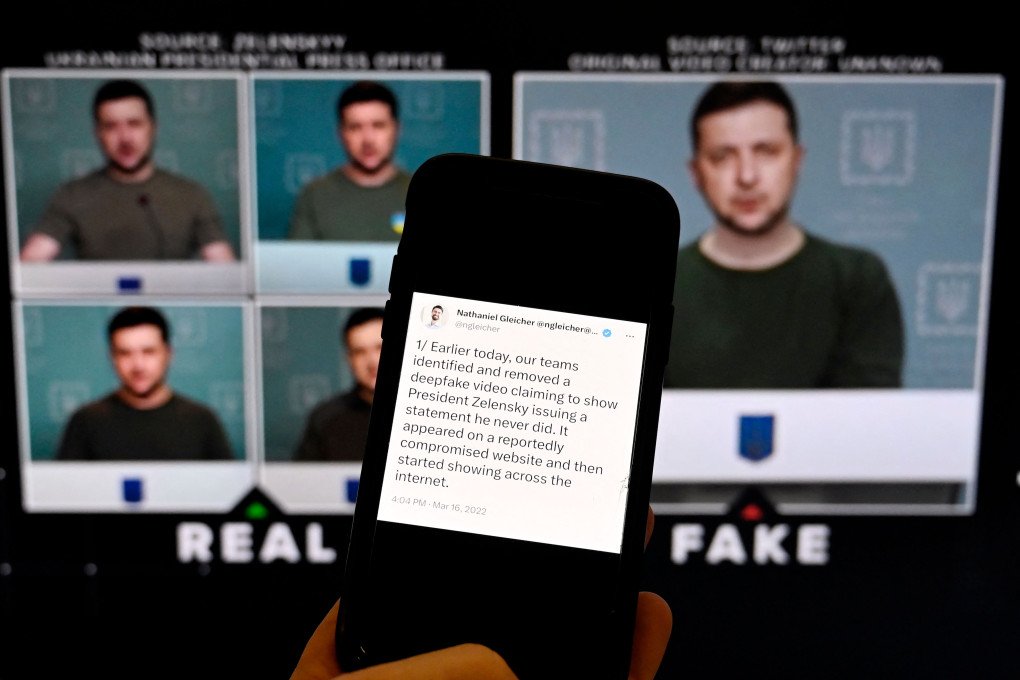

Un ejemplo destacado de desinformación impulsada por IA fue un vídeo falsificado que pretendía mostrar a la primera dama de Ucrania, Olena Zelenska, comprando un Bugatti de 4,8 millones de dólares. En el vídeo aparecía un falso empleado del concesionario y una factura falsificada. Aunque Bugatti París y los verificadores de hechos lo desmintieron rápidamente, el vídeo se hizo viral y obtuvo más de 20 millones de visitas. Esto subraya que incluso las falsificaciones mal hechas pueden tener un alcance masivo y sembrar la desconfianza pública.

Irán y Corea del Norte también utilizan activamente la IA con fines maliciosos. Irán ha integrado la IA en sus operaciones cibernéticas y campañas de influencia regional, empleando medios y personajes falsos generados por IA para evadir sanciones, coordinar ataques y manipular narrativas regionales. Corea del Norte utiliza IA generativa para crear identidades falsas con fines de espionaje, fraude financiero e infiltración. Estas capacidades permiten a Pyongyang generar ingresos y recabar información.

Russia is weaponizing AI to enhance its disinformation war: spreading fake narratives faster, more convincingly, and at massive scale.

— UNITED24 Media (@United24media) May 29, 2025

This is what you need to know 👇

(1/15) pic.twitter.com/5SyCsm6oG1

La IA como arma y como cuña

Las armas impulsadas por IA están alterando la dinámica central de la guerra. En Ucrania, la inteligencia artificial ya no es sólo una herramienta de apoyo. La IA es fundamental para las operaciones en el campo de batalla, guiando los ataques de precisión, acelerando las decisiones de mando y configurando el conocimiento de la situación en tiempo real. Al mismo tiempo, los regímenes autoritarios están utilizando la IA no para mejorar la eficacia, sino para controlar, desplegándola para desestabilizar los entornos de información y manipular la percepción exterior.

Los deepfakes se han convertido en un elemento básico de las operaciones psicológicas. Un vídeo falso de la primera dama ucraniana comprando un Bugatti de 4,8 millones de dólares se hizo viral a pesar de ser rápidamente desmentido. La eficacia de estas falsificaciones no radica en su calidad, sino en el momento en que se producen; explotan las narrativas y los prejuicios existentes antes de que la verdad pueda alcanzarlos.

El problema a largo plazo es estructural. Al sembrar Internet de contenidos falsos o distorsionados, los agentes estatales pueden influir en el comportamiento de los grandes modelos lingüísticos (LLM). A medida que la IA determina cada vez más la forma en que las personas acceden a la información y la comprenden, la integridad de sus datos de entrenamiento se convierte en una cuestión de seguridad estratégica.

El futuro

A medida que la IA se integra en los sistemas militares, la atención mundial se desplaza hacia la regulación, la seguridad y la transparencia. Prioridades clave: garantizar la seguridad de los datos de formación, aumentar la alfabetización digital y mejorar la rendición de cuentas en los modelos generativos.

Los países occidentales están empezando a tomar acción. Se está invirtiendo en detección de amenazas, ciberdefensa y coordinación transfronteriza. Los gobiernos están actualizando las doctrinas militares, redactando marcos jurídicos para contrarrestar la desinformación impulsada por la IA y lanzando campañas públicas para concienciar sobre las tecnologías de deepfake.

En Ucrania, continúa el desarrollo de sistemas de mando, plataformas robóticas de combate y drones impulsados por IA. La plataforma tecnológica Brave1 apoya a las startups de defensa de vanguardia y fomenta un ecosistema adaptativo para la innovación en seguridad y defensa.

Estados como Rusia, Irán y Corea del Norte también están ampliando sus arsenales de IA para la guerra de la información, el espionaje y el sabotaje económico. La evolución de sus tácticas está alimentando un panorama de amenazas dinámicas cada vez más difícil de vigilar o predecir.

La invasión rusa de Ucrania se ha convertido en la primera prueba real de la IA en la guerra. El objetivo ya no es sólo la superioridad militar. También se trata del control narrativo, la integridad de los datos y la influencia digital.

Escucha este artículo:

-19428fefbe2e33044463541807f3be57.jpeg)

-21f402f6f32da8b0165ae48804a71feb.jpeg)

-f1704327b95757a1131f927a0fdb4a88.jpg)

-3a3e88abd7d5e13a9ca10d295173a46a.jpeg)